¿Qué es el presupuesto de rastreo?

El presupuesto de rastreo es la cantidad de URLs que los motores de búsqueda, como Google, pueden y quieren rastrear en un sitio web dentro de un período determinado. Este concepto es clave en SEO, ya que determina qué páginas serán indexadas y con qué frecuencia se actualizarán en los resultados de búsqueda. El presupuesto de rastreo está influenciado por dos factores principales: el límite de rastreo y la demanda de rastreo.

¿Por qué los motores de búsqueda asignan un presupuesto de rastreo a los sitios web?

Los motores de búsqueda, como Google, asignan un presupuesto de rastreo (crawl budget) a cada sitio web con el fin de optimizar sus recursos y garantizar una buena experiencia tanto para sus servidores como para los administradores de los sitios. Este presupuesto se refiere a la cantidad de páginas que un bot está dispuesto a rastrear en un determinado período de tiempo, pero aunque parezca un concepto técnico, tiene un impacto directo en la visibilidad de un sitio en los resultados de búsqueda. Google no puede rastrear todo internet todos los días, por lo que prioriza qué sitios y páginas visitar en función de su relevancia, frecuencia de actualización y estado técnico. El presupuesto de rastreo está influenciado por dos factores principales:

- Límite de rastreo (Crawl Rate Limit): Define cuántas solicitudes puede hacer el bot sin sobrecargar el servidor del sitio web. Si el servidor responde lentamente o devuelve errores, el motor reducirá la velocidad de rastreo.

- Demanda de rastreo (Crawl Demand): Estima cuán relevante es rastrear ciertas páginas con base en su popularidad y actualizaciones recientes. Las páginas más solicitadas o con mayor autoridad reciben prioridad.

Los motores de búsqueda asignan este presupuesto por razones estratégicas:

- Evitar sobrecargar sitios con recursos limitados.

- Centrarse en rastrear contenido nuevo o actualizado en lugar de páginas obsoletas.

- Mejorar la eficiencia del índice, priorizando páginas con potencial de aparecer en los resultados.

¿Cómo asignan el presupuesto de rastreo a los sitios web?

La asignación no es aleatoria; responde a un proceso estratégico que considera tanto la capacidad del sitio como el valor percibido de sus contenidos. Dos factores principales influyen en cómo se asigna este presupuesto:

- Límite de rastreo o carga del host

- Demanda de rastreo o programación de rastreo

¿Por qué importa el presupuesto de rastreo en SEO?

Aunque el presupuesto de rastreo no es un factor de ranking directo, sí determina si y cuándo Google rastrea e indexa una página. Y si una página no se indexa, simplemente no aparece en los resultados de búsqueda. En este contexto, comprender la importancia del presupuesto de rastreo puede marcar una gran diferencia, especialmente en sitios web grandes o dinámicos. Entonces, ¿por qué debería preocuparte?

Porque una página no rastreada es una página invisible

Google necesita rastrear una página antes de poder evaluarla e indexarla. Si una URL no es rastreada por falta de presupuesto, no aparecerá en las búsquedas, sin importar cuán optimizada esté. Ejemplo: Un blog publica artículos diarios sobre tecnología, pero solo los primeros dos o tres posts se rastrean cada semana. El resto permanece fuera del índice, perdiendo visibilidad justo cuando la información es más relevante.

Porque afecta especialmente a ciertos tipos de sitios

Algunos sitios son particularmente vulnerables a los problemas de rastreo por su tamaño, frecuencia de actualización o estructura técnica. Sitios grandes con muchas URLs

- Directorios, foros o bases de datos con millones de páginas pueden consumir el presupuesto de rastreo muy rápido.

- Ejemplo: Un marketplace con 500.000 productos activos y 200.000 inactivos mantiene todas las URLs públicas. Googlebot gasta tiempo en productos obsoletos en lugar de rastrear los actuales.

E-commerce con inventarios dinámicos

- Las páginas de producto pueden cambiar frecuentemente (stock, precio, promociones), por lo que es vital que Google rastree esas páginas con regularidad.

- Ejemplo: Una tienda lanza una promoción flash, pero las páginas con descuentos no se rastrean a tiempo. Resultado: los usuarios no las encuentran en Google.

Sitios de noticias o medios digitales

- Publican contenido nuevo cada hora, y si no se rastrea a tiempo, pierde relevancia.

- Ejemplo: Un portal de noticias publica una exclusiva, pero esta no aparece en Google hasta un día después. El momento de mayor tráfico ya pasó.

Sitios con contenido generado dinámicamente

- Sistemas que generan muchas páginas a partir de combinaciones de filtros o parámetros URL pueden crear miles de páginas “nuevas”, muchas de las cuales no tienen valor real.

- Ejemplo: Un sitio de recetas permite filtrar por ingredientes, tiempo y dificultad, generando miles de combinaciones que saturan el rastreo.

¿Qué hacer con esta información?

Una vez que conoces tu presupuesto de rastreo y cómo se distribuye, puedes tomar decisiones más informadas:

- Reducir contenido duplicado o de poco valor para que Google invierta mejor su tiempo.

- Mejorar el rendimiento del servidor para que Googlebot pueda rastrear más páginas en menos tiempo.

- Revisar la arquitectura del sitio para que las páginas más importantes estén fácilmente accesibles.

- Limitar el acceso a secciones innecesarias usando robots.txt o etiquetas noindex.

- Actualizar sitemaps con las URLs prioritarias y recientes, para facilitar el rastreo.

Señales de que tienes problemas con el presupuesto de rastreo

Es posible que estés desperdiciando o malgastando el presupuesto de rastreo sin saberlo. Estas señales pueden ayudarte a identificarlo:

Páginas importantes no se indexan

Si publicas contenido nuevo y pasan días o semanas sin que aparezca en Google, es posible que no esté siendo rastreado.

- Ejemplo: Un sitio publica 10 nuevos artículos por semana. Solo 4 aparecen en el índice de Google. Los otros ni siquiera figuran en el sitemap como “descubiertos”.

Google rastrea páginas irrelevantes o de baja prioridad

Cuando Googlebot pasa tiempo rastreando URLs sin valor (filtros, búsquedas internas, parámetros duplicados), se reduce el presupuesto disponible para las páginas relevantes.

- Ejemplo: En una tienda online, Google rastrea con frecuencia URLs como /?color=azul&orden=asc, mientras que las páginas principales de categorías apenas se rastrean una vez al mes.

Alta frecuencia de rastreo en páginas que no cambian

Si Googlebot sigue rastreando secciones estáticas que no se actualizan, estás desperdiciando presupuesto.

- Ejemplo: Un archivo de noticias de 2012 recibe cientos de visitas de Googlebot cada semana, mientras que artículos recientes no se rastrean con la misma frecuencia.

Tiempo de publicación vs tiempo de aparición en resultados

Un retraso excesivo entre publicar y aparecer en las SERP puede indicar un problema de rastreo.

- Ejemplo: Un sitio lanza contenido estacional, como “guía de regalos para Navidad”, pero solo aparece en Google una semana después de publicarlo, perdiendo tiempo valioso.

Errores de rastreo frecuentes

Errores 404, redirecciones en cadena o páginas lentas también consumen presupuesto sin aportar valor.

- Ejemplo: Googlebot intenta rastrear 10.000 URLs y se encuentra con 2.000 errores 404. Todo ese rastreo fallido reduce el número de páginas válidas que pueden ser rastreadas e indexadas.

Elementos que afectan la demanda de rastreo:

A diferencia del límite de rastreo, que está relacionado con la capacidad técnica del servidor, la demanda de rastreo se basa en el interés que el contenido del sitio genera para el buscador. Google prioriza las URLs que considera más relevantes, los elementos principales que influyen en esta decisión son: Popularidad de la URL Cuanto más popular sea una URL, mayor será la probabilidad de que Google la rastree con frecuencia.

Factores que influyen en la popularidad:

- Enlaces internos: Páginas que reciben muchos enlaces desde otras secciones del mismo sitio se consideran más importantes.

- Backlinks externos: Enlaces entrantes desde otros dominios aumentan la autoridad percibida de la página.

- Compartidos en redes sociales: Aunque no todos los enlaces sociales transmiten autoridad, sí pueden aumentar la visibilidad y el tráfico, lo que Google interpreta como interés.

Frecuencia de actualización

Google prefiere rastrear más seguido las páginas que cambian con frecuencia, ya que estas pueden ofrecer contenido más fresco o relevante.

Páginas con alta frecuencia de actualización:

- Portadas de noticias.

- Blogs activos con nuevas publicaciones constantes.

- E-commerce con cambios de precios o disponibilidad.

Recomendaciones:

- Actualizar regularmente el contenido más importante.

- Añadir nuevas secciones o ampliar la información existente.

- No modificar innecesariamente páginas solo para forzar el rastreo (puede ser penalizado si se percibe como manipulación)

Historial del sitio

El comportamiento histórico de un sitio web influye en cómo Google confía en él para asignar presupuesto de rastreo. Un sitio que ha demostrado ser consistente en la calidad y frecuencia de su contenido gana credibilidad con el tiempo.

Elementos que construyen un historial sólido:

- Publicaciones frecuentes y útiles.

- Bajos niveles de errores 404 o enlaces rotos.

- Experiencia de usuario positiva (páginas rápidas, sin spam ni contenido duplicado)

Autoridad del dominio

Dominios de gran autoridad, como medios de comunicación o sitios institucionales, tienden a recibir un rastreo más amplio y frecuente.

Factores que influyen en la autoridad:

- Cantidad y calidad de enlaces entrantes.

- Antigüedad del dominio.

- Reconocimiento de marca en línea.

Diferencias según el tamaño del sitio:

- Grandes sitios: Pueden recibir millones de solicitudes de rastreo al día.

- Sitios pequeños o nuevos: Reciben menos visitas de rastreadores hasta ganar reputación de marca.

Factores que influyen en el presupuesto de rastreo

El presupuesto de rastreo que asignan los motores de búsqueda está condicionado por múltiples factores. Entre ellos, el límite de rastreo y la demanda de rastreo son los dos más determinantes. Ambos interactúan de manera dinámica para definir cuántas páginas de un sitio web serán rastreadas, con qué frecuencia y en qué orden de prioridad.

Límite de rastreo

El límite de rastreo representa la cantidad máxima de solicitudes que un bot de motor de búsqueda puede hacer a un sitio sin comprometer su estabilidad o rendimiento. Este límite está vinculado al comportamiento del servidor y a la velocidad con la que se responden las peticiones de rastreo.

Factores que influyen en el límite de rastreo

Factor | Descripción |

Capacidad del servidor | Los motores de búsqueda determinan cuánto tráfico adicional puede soportar el servidor sin ralentizarse. Servidores robustos permiten un volumen mayor de rastreo. |

Velocidad de respuesta del sitio | La rapidez con la que el servidor entrega contenido influye directamente. Si las respuestas son ágiles, el motor puede aumentar el número de solicitudes. |

Errores 5xx detectados durante el rastreo | Una alta frecuencia de errores como 500 o 503 lleva al motor de búsqueda a reducir su ritmo de rastreo para no empeorar la situación. |

Tiempos de carga variables | Si hay oscilaciones frecuentes en los tiempos de carga (picos de lentitud), el rastreo se ajusta automáticamente hacia la baja. |

Restricciones definidas por el sitio | El archivo robots.txt o configuraciones en Google Search Console pueden limitar el ritmo de rastreo, afectando directamente el límite asignado. |

Carga concurrente de usuarios reales | Si el tráfico de usuarios humanos es alto y coincide con el rastreo del bot, se puede reducir la actividad del rastreador para evitar interferencias. |

Ubicación geográfica del servidor | Servidores lejanos a los centros de datos del motor de búsqueda presentan tiempos de respuesta más largos, lo que afecta el límite. |

Tecnología del servidor | Tecnologías eficientes como NGINX o arquitecturas sin bloqueo permiten un rastreo más fluido y constante. |

Tamaño de las páginas | Páginas con muchos recursos embebidos o muy pesadas pueden consumir más ancho de banda y reducir la cantidad total de páginas rastreadas. |

Configuración de redirecciones | Redirecciones en cadena, múltiples saltos o redirecciones mal gestionadas incrementan el tiempo de procesamiento y reducen la capacidad efectiva de rastreo. |

Demanda de rastreo

La demanda de rastreo se relaciona con cuán importante o actual considera un motor de búsqueda que es el contenido de un sitio. Este factor determina qué páginas se rastrean con más frecuencia, basándose en señales de relevancia, actualización y conectividad interna y externa.

Elementos que influyen en la demanda de rastreo

Elemento | Descripción |

Popularidad de la página | Las páginas con más enlaces entrantes (internos y externos) tienen mayor prioridad para ser rastreadas. |

Autoridad percibida de la URL | URLs con buen historial, enlaces de calidad o relevancia temática reciben más atención del rastreador. |

Frecuencia de actualización del contenido | Las URLs que se actualizan regularmente son rastreadas con mayor frecuencia. |

Historial de cambios en la URL | Páginas que han sido dinámicas en el pasado tienden a recibir visitas más frecuentes del bot. |

Volumen de tráfico estimado | Páginas con visitas recurrentes se consideran útiles y se prioriza su rastreo. |

Ubicación en la jerarquía del sitio | Páginas cercanas a la home o con múltiples accesos internos se perciben como más importantes. |

Enlaces internos apuntando a la página | URLs bien enlazadas desde otras secciones del sitio son rastreadas más a menudo. |

Cantidad y calidad de enlaces externos | Backlinks desde sitios con autoridad aumentan el valor percibido de la página. |

Cambios en la estructura del sitio web | Las modificaciones en la arquitectura provocan un rastreo más intenso temporalmente. |

Canonicalización y contenido duplicado | Las URLs canónicas ganan prioridad; las duplicadas, menos. |

Datos estructurados (Schema.org) | Facilitan la interpretación del contenido y pueden incentivar más rastreos. |

Participación en actualizaciones del índice | Cambios en el algoritmo pueden aumentar temporalmente el rastreo para reevaluar contenido. |

Actualidad del tema tratado | Contenidos sobre noticias o tendencias recientes reciben más atención. |

Interacción en redes sociales | Páginas muy compartidas pueden generar señales que aumentan su rastreo. |

Volumen de páginas nuevas creadas | Sitios con alta frecuencia de publicación exigen más rastreo para indexar el nuevo contenido. |

Interacciones del usuario | Clics, tiempo de permanencia o rebotes podrían influir en la prioridad de rastreo (aunque no está confirmado). |

Estado previo de indexación | URLs con errores o sin indexar pueden ser revisitadas para confirmar su estado. |

¿Cómo saber cuál es el presupuesto de rastreo de mi sitio web?

En el mundo del SEO técnico, el Crawl Budget se ha convertido en un concepto esencial, sobre todo para sitios grandes o de actualización frecuente. Aunque no todos los motores de búsqueda ofrecen datos claros al respecto, Google es, con diferencia, el más transparente.

¿Qué tan seguido Google rastrea tu sitio?

La frecuencia y profundidad de ese rastreo dependen de múltiples factores: velocidad del servidor, estructura del sitio, calidad del contenido, enlaces entrantes, entre otros. Google no rastrea todos los sitios de la misma manera. Mientras que algunos reciben cientos de visitas diarias del bot, otros apenas son revisados unas pocas veces al mes. Esto está directamente relacionado con el presupuesto de rastreo asignado por Google, el cual puedes monitorear desde su propia plataforma.

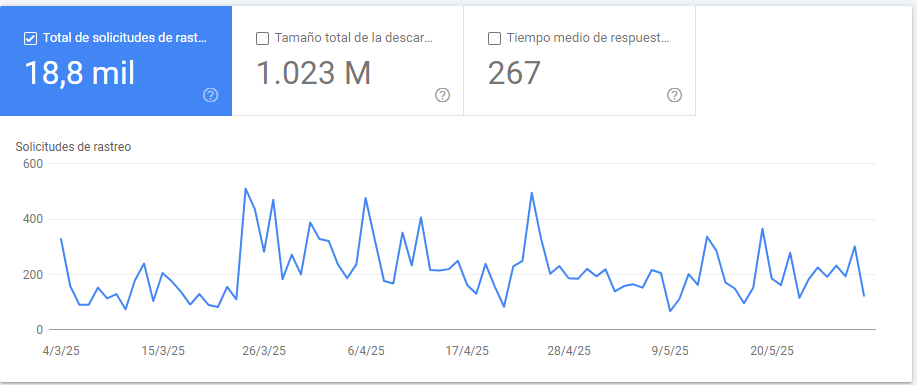

Usar Google Search Console para conocer tu presupuesto de rastreo

Google Search Console (GSC) es la herramienta oficial que te permite verificar el comportamiento de Googlebot en tu sitio web. Una de sus secciones más útiles para esto es el informe de “Estadísticas de rastreo”. Pasos para acceder a esta información:

- Accede a tu cuenta en Google Search Console.

- Selecciona la propiedad (sitio web) que deseas analizar.

- Dirígete a la sección “Configuración” o ve directamente a “Estadísticas de rastreo” (en el menú lateral).

- Allí encontrarás un desglose del número de páginas que Google rastrea diariamente, el tamaño de los datos descargados y el tiempo medio de respuesta del servidor.

Este informe te da una visión clara de cuántas URLs Google visita por día, cómo ha evolucionado esa cifra en el tiempo, y si hay picos, caídas o comportamientos inusuales que puedan requerir atención.

Un ejemplo práctico sobre cómo cambia el rastreo con el tiempo

Para ilustrar cómo puede evolucionar el presupuesto de rastreo, pensemos en un ejemplo real. Imagina un sitio web mediano, recién lanzado, que empieza con un volumen de rastreo de apenas 30 páginas al día. Esto equivale a unas 900 páginas al mes. Si el sitio se mantiene saludable, crece en enlaces, mejora su rendimiento y gana autoridad, es muy probable que Google aumente ese volumen. Supón que dos años más tarde, ese mismo sitio recibe más de 250 rastreos diarios. Eso equivale a más de 7.000 páginas al mes, un incremento de casi 10 veces en capacidad de rastreo.Este crecimiento suele estar vinculado a:

- Aumento del contenido indexable y relevante.

- Mejoras técnicas en la estructura del sitio.

- Incremento en la frecuencia de publicación.

- Disminución de errores técnicos (páginas 404, redirecciones excesivas, contenido duplicado).

Comparar Google Search Console con los registros del servidor

Aunque GSC es muy útil, no ofrece un panorama completo. Para tener una visión más profunda, lo ideal es complementar estos datos con el análisis de los registros del servidor (log files).

¿Qué son los registros del servidor?

Son archivos que recogen todas las peticiones realizadas al servidor de tu sitio web, incluyendo las visitas de rastreadores como Googlebot. Analizarlos te permite:

- Ver exactamente qué URLs rastrea Google.

- Detectar patrones de comportamiento.

- Identificar URLs que se rastrean con demasiada frecuencia (o muy poco).

- Confirmar si Google está desperdiciando presupuesto en páginas irrelevantes.

¿Por qué comparar ambas fuentes?

- Google Search Console te da una visión agregada del rastreo, con promedios diarios y tendencias.

- Los registros del servidor te muestran el comportamiento detallado y exacto, página por página.

Un análisis cruzado te puede revelar, por ejemplo, que Google está ignorando ciertas secciones importantes de tu sitio o que gasta recursos en rastrear filtros, parámetros duplicados o contenido obsoleto.

¿Cómo aumentar el presupuesto de rastreo de tu sitio web?

El presupuesto de rastreo determina cuántas páginas de tu sitio puede y quiere rastrear Google en un período de tiempo determinado. Aunque este número no es fijo ni público, existe una relación directa entre la importancia que Google percibe en tus páginas y la cantidad de atención que les dedica. Una de las claves para influir en este comportamiento es aumentar la autoridad de tus páginas, un concepto estrechamente vinculado a lo que antes se conocía como PageRank. Aunque Google ya no publica esta métrica, se sabe que sigue usando una versión de ella en sus algoritmos.

La importancia de la autoridad de página

En esencia, cuanto más valor tenga tu página principal -reflejado en la cantidad y calidad de los enlaces entrantes que recibe-, mayor será su autoridad. Esa autoridad se transmite internamente cuando enlazas desde esa página a otras secciones de tu sitio, ayudando a que Google también rastree esas otras URLs. Conforme te alejas de la página principal en términos de estructura, esa autoridad se va diluyendo. Esto significa que las páginas más profundas o mal enlazadas suelen recibir menos rastreo, o incluso pueden ser ignoradas.

¿Cómo optimizar el Crawl Budget?

Este enfoque técnico y sistemático te permitirá canalizar correctamente los recursos de los motores de búsqueda hacia las áreas más importantes del sitio web, maximizando su visibilidad y rendimiento orgánico.

Evitar contenido duplicado

El contenido duplicado puede generar un uso ineficiente del presupuesto de rastreo al obligar a los bots a rastrear versiones redundantes de la misma información. Para prevenir esta situación, es esencial aplicar las siguientes acciones detalladas:

- Implementar etiquetas canónicas: Agregar la etiqueta

rel=\"canonical\"en el<head>de las páginas duplicadas para indicar cuál es la versión principal que debe considerarse para indexación. - Configurar redirecciones 301: Cuando se detecten versiones duplicadas que ya no se deben mostrar, redirigirlas permanentemente hacia la URL preferida.

- Bloquear vías redundantes en robots.txt: Utilizar el archivo

robots.txtpara impedir que los bots accedan a rutas o parámetros que generen duplicaciones, como filtros de orden o sesión. - Auditar contenido duplicado con herramientas SEO: Usar plataformas como Screaming Frog, Ahrefs o SEMrush para localizar duplicaciones y consolidarlas.

Mejorar la velocidad del sitio

Un sitio rápido permite que los bots rastreen más contenido en menos tiempo, aumentando la eficiencia del crawl budget. Las acciones técnicas recomendadas incluyen:

- Optimizar tamaño de imágenes: Comprimir imágenes sin perder calidad utilizando herramientas como TinyPNG o WebP.

- Activar almacenamiento en caché: Implementar caché a nivel de navegador y servidor para evitar que los recursos se carguen desde cero en cada visita.

- Reducir scripts innecesarios: Eliminar o aplazar scripts que no son críticos, como plugins obsoletos o funciones no utilizadas.

- Implementar CDN: Distribuir el contenido estático a través de una red de servidores global (Cloudflare, Akamai) para disminuir la latencia.

- Minificar archivos CSS, JS y HTML: Reducir el tamaño de los archivos eliminando espacios, comentarios y caracteres innecesarios.

Gestionar URLs con parámetros

Los parámetros en las URLs pueden crear miles de combinaciones que diluyen el rastreo eficaz. Para mitigar este problema:

- Usar la herramienta de parámetros en Google Search Console: Especificar qué parámetros afectan el contenido y cuáles no, para guiar al bot.

- Bloquear parámetros no informativos en robots.txt: Evitar el rastreo de URLs con parámetros como

?ref=,?sort=,?sessionid=, entre otros. - Consolidar vías con etiquetas canónicas: Verificar que todas las versiones de una página con parámetros apunten a una versión canónica.

- Evitar enlaces internos hacia URLs parametrizadas: Asegurarse de que la navegación interna dirija hacia versiones limpias de las URLs.

Optimizar la estructura de enlaces internos

Una estructura interna bien organizada permite a los bots navegar el sitio de manera eficiente, enfocándose en las páginas clave. El proceso incluye:

- Diseñar jerarquía clara: Organizar el sitio en niveles lógicos (home > categorías > subcategorías > contenido) con estructura piramidal.

- Vincular internamente desde contenido relevante: Añadir enlaces contextuales hacia otras páginas dentro del contenido para reforzar la autoridad y descubrimiento.

- Auditar enlaces rotos: Usar herramientas para identificar y corregir errores 404 o redirecciones innecesarias.

- Usar menús y migas de pan estructuradas: Facilitar la navegación tanto a usuarios como bots mediante rutas claras.

- Evitar estructuras profundas: Reducir la cantidad de clics necesarios para acceder a contenido relevante (idealmente no más de 3 clics desde la página principal).

Eliminar páginas de baja calidad

Las URLs sin valor SEO pueden consumir recursos de rastreo sin aportar beneficios. Para depurarlas correctamente:

- Realizar auditoría de contenido: Revisar todas las URLs para identificar contenido pobre, duplicado o sin tráfico.

- Eliminar o consolidar: Borrar definitivamente las páginas sin valor o fusionarlas con contenido relacionado más completo.

- Redirigir páginas obsoletas: Usar redirecciones 301 hacia otras URLs relevantes para conservar parte de la autoridad.

- Evitar indexación de thin content: Etiquetar páginas irrelevantes con

noindexsi deben mantenerse por razones funcionales pero no merecen ser indexadas. - Controlar el contenido generado por usuarios: Moderar secciones como comentarios, foros o perfiles para evitar spam o contenido irrelevante.

Revisión continua y monitoreo

La optimización del crawl budget no es un proceso único. Se debe mantener una estrategia de mejora continua:

- Monitorear rastreo en Google Search Console: Revisar el informe de estadísticas de rastreo para detectar cuellos de botella o cambios inesperados.

- Analizar logs del servidor: Observar los accesos de Googlebot para entender qué páginas están siendo rastreadas y cuánto tiempo toma.

- Establecer KPIs de eficiencia de rastreo: Definir indicadores como % de páginas prioritarias rastreadas, % de errores 5xx, o % de rastreo desperdiciado.

- Actualizar robots.txt y sitemap regularmente: Asegurarse de que reflejen con precisión el contenido relevante y accesible.

Herramientas para analizar el presupuesto de rastreo

Entre las herramientas SEO más potentes para analizar el Crawl Budget están:

Google Search Console

Google Search Console ofrece informes sobre el rastreo de un sitio web, incluyendo el número de páginas rastreadas y los errores detectados. Algunas secciones clave para analizar incluyen:

- Estadísticas de rastreo: Muestra la cantidad de solicitudes realizadas por Googlebot

- Cobertura del índice: Indica qué páginas han sido indexadas y cuáles presentan problemas

- Sitemaps: Permite verificar si los mapas del sitio están correctamente procesados

Registros del servidor

Los registros del servidor contienen información detallada sobre las solicitudes realizadas por los motores de búsqueda. Analizar estos archivos permite identificar patrones de rastreo y detectar posibles problemas. Algunas herramientas para analizar registros incluyen:

- Screaming Frog Log File Analyzer

- Splunk

- AWStats

Herramientas de rastreo

Existen diversas herramientas que permiten simular el rastreo de un sitio web para detectar problemas técnicos y oportunidades de optimización. Algunas opciones populares incluyen:

- Screaming Frog SEO Spider

- Sitebulb

- DeepCrawl

Te recomendamos este video sobre el Crawl Budget explicado por DinoRank:

Impulsa tu marca con estrategias digitales que generan impacto

¿Quieres destacar en el mundo digital y atraer a más clientes? En Agencia Seology te ayudamos a lograrlo combinando visión estratégica con experiencia comprobada. Nuestro enfoque está pensado para marcas, emprendedores y profesionales que buscan tomar decisiones acertadas, optimizar su presencia online y convertir cada acción en un resultado concreto. Desde nuestro blog compartimos recursos actualizados, consejos prácticos y análisis en profundidad para que aproveches al máximo el potencial de tu negocio en línea. En Seology, creemos que una estrategia digital bien ejecutada no solo mejora tu visibilidad, sino que impulsa un crecimiento sostenible. Consulta con nuestros expertos:

- Consultoría SEO a medida, adaptada a los objetivos específicos de cada proyecto.

- Auditorías SEO profesionales para detectar y corregir problemas técnicos.

- Estrategias SEO para ecommerce, enfocadas en aumentar la visibilidad y conversión de tiendas online.

- Link Building estratégico, con prácticas seguras y efectivas para mejorar tu autoridad.

- SEO local, ideal para negocios que quieren destacar en búsquedas geográficas.

- SEO internacional para empresas que buscan posicionarse en distintos mercados.

- Gestión de migraciones SEO, asegurando que tu tráfico orgánico no se vea afectado.

- Publicidad digital con Google Ads, para atraer tráfico segmentado de manera inmediata.

- SEO para Abogados

Lleva tu estrategia SEO al siguiente nivel

Dominar conceptos como este es fundamental para una estrategia SEO exitosa. Si buscas implementar estas técnicas con el respaldo de expertos, en Seology te ayudamos. Nuestra agencia SEO Colombia ofrece soluciones personalizadas para el mercado colombiano, mientras que nuestra Agencia SEO en Chile está especializada en posicionar marcas en el competitivo mercado chileno.