¿Qué es la indexabilidad en SEO?

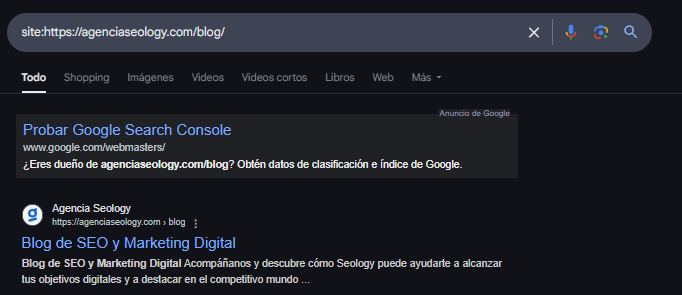

La indexabilidad es la capacidad de una página web para ser rastreada e incluida en el índice de los motores de búsqueda. Si una página no es indexable, no aparecerá en los resultados de búsqueda, lo que significa que los usuarios no podrán encontrarla a través de Google u otros buscadores.

Los motores de búsqueda utilizan bots para rastrear e indexar páginas web. Sin embargo, no todas las páginas son indexadas automáticamente. Factores como la configuración del sitio, el archivo robots.txt o las etiquetas meta pueden influir en la indexabilidad de una página.

Diferencia entre rastreo e indexación

El rastreo y la indexación son procesos distintos en SEO. El rastreo es cuando los bots de los motores de búsqueda visitan una página para analizar su contenido y estructura. La indexación ocurre cuando esa página es almacenada en la base de datos del motor de búsqueda y puede aparecer en los resultados de búsqueda.

Una página puede ser rastreada pero no indexada si existen restricciones que impiden su almacenamiento en el índice del motor de búsqueda.

Aspecto | Rastreo (Crawling) | Indexación (Indexing) |

Definición | Es el proceso mediante el cual los motores de búsqueda, como Googlebot, recorren las páginas web para descubrir su contenido y estructura. | Es la etapa posterior al rastreo, donde Google analiza y almacena la información de las páginas rastreadas en su índice para mostrarla en los resultados de búsqueda. |

Objetivo principal | Descubrir nuevas páginas o actualizaciones en un sitio web. | Registrar y clasificar las páginas en el índice de Google para que puedan aparecer en los resultados de búsqueda. |

Herramienta principal de Google | Googlebot (el robot de rastreo de Google). | Google Index (la base de datos donde se almacena el contenido procesado). |

Resultado del proceso | Google conoce la existencia de la página, pero aún no la muestra en los resultados. | La página ya puede aparecer en los resultados de búsqueda si se considera relevante y de calidad. |

¿Qué hace que una página sea indexable?

Para que Google incluya una página en su índice, necesita cumplir tres condiciones básicas. Si falla cualquiera de las tres, la página no aparecerá en los resultados de búsqueda, independientemente de la calidad de su contenido.

1. Tiene que ser rastreable

Googlebot necesita poder acceder a la URL sin restricciones. Si la página está bloqueada en el archivo robots.txt o devuelve un error de servidor, el bot no puede leerla y tampoco puede indexarla. Una página inaccesible es una página invisible para Google.

2. No debe tener una etiqueta noindex

La etiqueta <meta name="robots" content="noindex"> le dice explícitamente a Google que no incluya esa página en su índice. Es un bloqueo a nivel de contenido, diferente al del robots.txt. Una página puede ser perfectamente rastreable y aun así tener noindex activo por error.

3. Debe tener una URL canónica correcta

Si una página tiene una etiqueta canonical apuntando a otra URL diferente, Google indexará la URL canónica, no la que está viendo. En sitios con muchas URLs similares (como e-commerce con filtros de precio, color o talla), una mala configuración de canonicals puede dejar páginas importantes fuera del índice sin que nadie lo note.

Factores que afectan la indexabilidad

Archivo robots.txt

El archivo robots.txt se encuentra en la raíz de un sitio web y se usa para indicar a los bots qué páginas pueden o no pueden rastrear. Si una página está bloqueada en este archivo, los motores de búsqueda no podrán acceder a su contenido, lo que puede afectar su indexabilidad.

Etiquetas meta robots

Las etiquetas meta robots permiten controlar la indexación de una página. Algunas de las más utilizadas son:

- index: Indica que la página debe ser indexada.

- noindex: Evita que la página sea indexada.

- follow: Permite que los bots sigan los enlaces de la página.

- nofollow: Indica que los enlaces de la página no deben ser seguidos.

Si una página tiene la etiqueta meta robots con el valor noindex, los motores de búsqueda no la incluirán en su índice.

Estado del servidor y códigos de respuesta

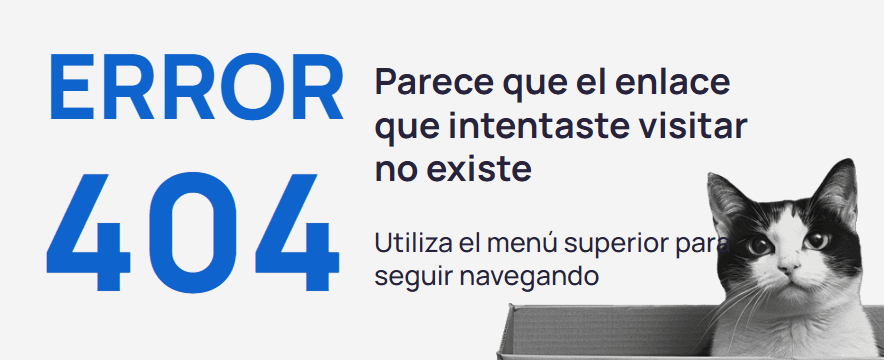

Los códigos de respuesta HTTP pueden influir en la indexabilidad de una página. Algunos de los más relevantes son:

- 200 (OK): Indica que la página está disponible y puede ser indexada.

- 301 (Redirección permanente): Redirige a otra URL y transfiere la autoridad de la página original.

- 302 (Redirección temporal): Indica que la redirección es temporal y puede afectar la indexación.

- 404 (No encontrado): Señala que la página no existe, lo que impide su indexación.

- 410 (Eliminado): Indica que la página ha sido eliminada permanentemente.

Contenido duplicado

El contenido duplicado puede afectar la indexabilidad de una página, ya que los motores de búsqueda pueden decidir no indexarla si consideran que es una copia de otra página existente. Para evitar problemas de indexación por contenido duplicado, se pueden utilizar etiquetas canonical para indicar la versión preferida de una página.

Velocidad de carga y rendimiento del sitio

Los motores de búsqueda priorizan sitios web rápidos y optimizados. Si una página tarda demasiado en cargar, los bots pueden abandonar el rastreo antes de indexarla. Factores como el tamaño de las imágenes, el uso de caché y la optimización del código pueden mejorar la velocidad de carga y favorecer la indexabilidad.

Experiencia de usuario y accesibilidad

Una buena experiencia de usuario también influye en la indexabilidad. Páginas con una estructura clara, enlaces internos bien organizados y un diseño responsive tienen mayores probabilidades de ser indexadas correctamente.

Cómo diagnosticar problemas de indexabilidad

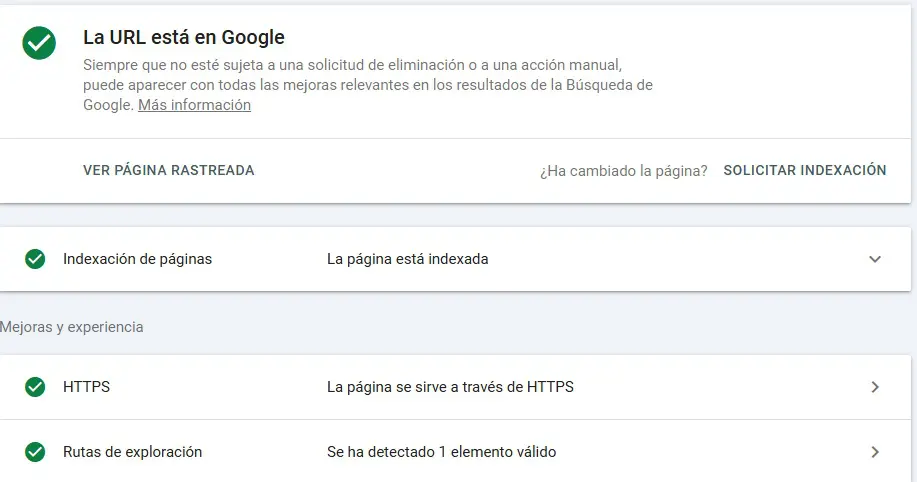

Antes de corregir, hay que saber qué está fallando. Google Search Console es el punto de partida para cualquier diagnóstico de indexabilidad, y en la mayoría de los casos permite identificar el problema sin necesidad de herramientas de pago.

El informe de Páginas en Google Search Console

Dentro de GSC, el informe Páginas muestra el estado de indexación de todas las URLs que Google conoce de tu sitio, organizadas en cuatro categorías: indexadas, no indexadas, excluidas y con errores. Las más importantes a revisar:

- Excluida por etiqueta noindex: páginas que están bloqueadas de forma intencional (o por error).

- Excluida por canonical: Google encontró una URL canónica diferente a la que le presentaste. Puede indicar una mala configuración.

- Rastreada, pendiente de indexación: Google visitó la página pero decidió no incluirla todavía. Suele ser señal de contenido de baja calidad o presupuesto de rastreo insuficiente.

- Detectada, no rastreada: Google sabe que existe pero aún no la ha visitado. El sitemap la lista pero el bot no ha llegado hasta ella.

La herramienta de Inspección de URL

Para revisar el estado de una página específica, usa la función Inspeccionar URL dentro de GSC. Muestra si la página está indexada, cuándo fue rastreada por última vez, cómo la ve Google después de renderizar el JavaScript y si hay algún bloqueo activo.

Señales de alerta que no hay que ignorar

- Un número de páginas indexadas mucho menor que el total de páginas del sitio puede indicar problemas de presupuesto de rastreo o contenido de baja calidad masivo.

- Muchas páginas en “rastreada, pendiente de indexación” apuntan a un problema de calidad de contenido, no técnico.

- Páginas clave con errores de cobertura son prioridad inmediata: cada día fuera del índice es tráfico perdido.

¿Cómo mejorar la indexabilidad de un sitio web?

La indexabilidad es la capacidad que tiene un sitio web para ser comprendido y almacenado por los motores de búsqueda, como Google, en sus índices. Mejorarla significa facilitar que los robots encuentren, comprendan e incluyan tus páginas en los resultados de búsqueda. Una web con buena indexabilidad tiene mayores posibilidades de posicionarse mejor y aumentar su tráfico orgánico.

1. Permitir el rastreo de los motores de búsqueda

Antes de pensar en indexar, Google debe poder rastrear tu sitio. Es fundamental revisar dos elementos esenciales:

- Archivo robots.txt:

Este archivo indica a los motores de búsqueda qué partes del sitio pueden o no rastrear. Un error común es bloquear secciones importantes sin intención. - Asegúrate de que las URLs clave no estén bloqueadas con “Disallow”.

- Mantén accesibles las carpetas donde se aloja el contenido principal (como /blog/ o /productos/).

- Metaetiquetas robots:

Las etiquetaspueden impedir que una página sea indexada. - Úsalas solo en páginas que no aporten valor al SEO (por ejemplo, resultados internos o páginas de prueba).

- En el contenido relevante, asegúrate de usar index, follow o simplemente no incluir la etiqueta.

Permitir un rastreo adecuado garantiza que Google pueda acceder a las páginas correctas y considerar su contenido para la indexación.

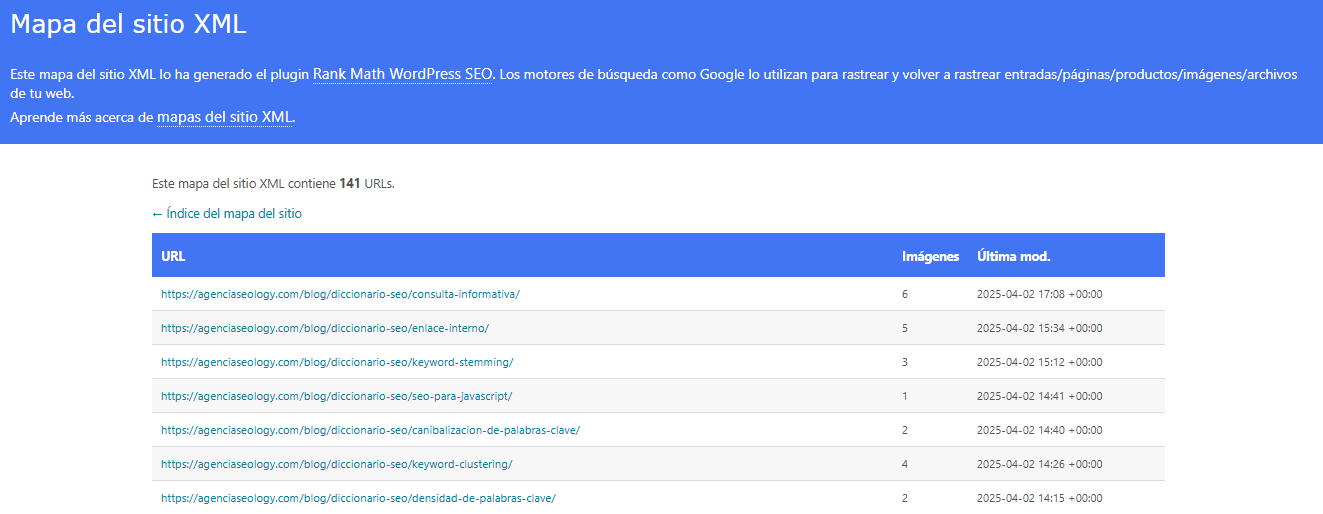

2. Crear un sitemap XML

Un sitemap XML funciona como un mapa de navegación para los motores de búsqueda. Este archivo detalla todas las páginas importantes del sitio y ayuda a los bots a descubrir contenido nuevo o actualizado.

Buenas prácticas:

- Incluye solo las páginas canónicas y de valor (no las duplicadas ni las de prueba).

- Actualiza el sitemap regularmente cuando publiques o elimines contenido.

- Envíalo a Google Search Console y Bing Webmaster Tools para facilitar su procesamiento.

- Usa herramientas como Yoast SEO, Screaming Frog o XML Sitemaps para generarlo automáticamente.

Un sitemap bien configurado acelera la detección de nuevas URLs y mejora la cobertura del índice.

3. Optimizar la estructura de enlaces internos

Los enlaces internos permiten a los motores de búsqueda navegar entre las distintas secciones del sitio. Además, distribuyen la autoridad y relevancia entre las páginas.

Consejos para optimizar los enlaces internos:

- Crea una arquitectura lógica y jerárquica, con categorías principales, subcategorías y contenido relacionado.

- Asegúrate de que todas las páginas importantes estén a pocos clics desde la página principal.

- Usa anclas descriptivas (texto del enlace) que indiquen claramente el tema de la página de destino.

- Evita los enlaces rotos o bucles que confundan a los rastreadores.

Una estructura interna sólida mejora tanto la indexabilidad como la experiencia del usuario.

4. Evitar contenido duplicado

El contenido duplicado es uno de los principales enemigos de la indexabilidad. Google puede confundirse al decidir qué versión de una página mostrar, lo que diluye la autoridad y afecta el posicionamiento.

Cómo evitarlo:

- Implementa la etiqueta canonical (<link rel=”canonical” href=”URL-principal” />) para indicar la versión original de una página.

- Evita crear múltiples URLs con contenido similar (por ejemplo, versiones con parámetros, filtros o sesiones).

- No publiques el mismo texto en distintas secciones o dominios sin necesidad.

- Revisa regularmente tu sitio con herramientas como Siteliner, Ahrefs o Semrush para detectar duplicados.

La coherencia y unicidad del contenido favorecen que los motores de búsqueda indexen las versiones correctas.

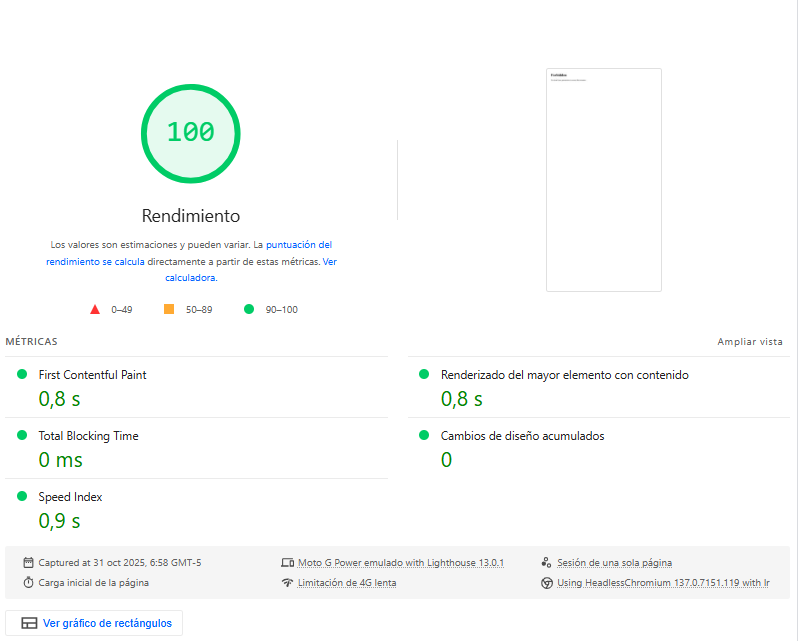

5. Mejorar la velocidad de carga

La velocidad del sitio es un factor clave para la indexabilidad y la experiencia del usuario. Si las páginas tardan en cargar, Googlebot puede abandonar el rastreo antes de tiempo.

Acciones recomendadas:

- Optimiza las imágenes usando formatos ligeros (como WebP) y compresión.

- Minimiza el código CSS y JavaScript para reducir el peso total de la página.

- Usa una red CDN (Content Delivery Network) para entregar el contenido desde servidores cercanos al usuario.

- Activa la compresión GZIP y la caché del navegador.

- Revisa el rendimiento con Google PageSpeed Insights o Lighthouse.

Una web rápida no solo mejora la indexabilidad, sino también la satisfacción del visitante.

6. Usar Google Search Console para detectar problemas de indexación

Google Search Console (GSC) es una herramienta esencial para monitorear la salud de la indexación de un sitio.

Cómo aprovecharla:

- Revisa el informe “Páginas indexadas” para identificar URLs incluidas o excluidas del índice.

- Usa la función “Inspeccionar URL” para comprobar el estado de indexación de una página específica.

- Consulta los errores de cobertura para detectar bloqueos, redirecciones erróneas o páginas sin contenido.

- Envía el sitemap.xml y verifica su procesamiento.

Además, GSC muestra información sobre rastreo, enlaces, rendimiento de búsqueda y posibles problemas de usabilidad, lo que permite tomar decisiones informadas.

Herramientas para analizar la indexabilidad

Existen diversas herramientas que permiten detectar errores de rastreo, páginas bloqueadas, contenido duplicado o problemas de rendimiento que afectan la aparición en los resultados de búsqueda. Utilizar estos recursos facilita la toma de decisiones técnicas y estratégicas para optimizar la visibilidad del sitio y mejorar su posicionamiento en Google.

Herramienta | Descripción | Funciones principales | Ventajas destacadas | Uso recomendado |

Google Search Console | Plataforma gratuita de Google que permite supervisar y mantener la presencia del sitio en los resultados de búsqueda. | – Verificación de páginas indexadas o excluidas. – Informe de cobertura y errores de rastreo. – Envío y validación del sitemap XML. | – Gratuita y oficial de Google. – Datos directos del motor de búsqueda. – Alertas automáticas de problemas de indexación. | Ideal para monitorear el estado de indexación y solucionar errores críticos en tiempo real. |

Screaming Frog SEO Spider | Software de escritorio que rastrea sitios web simulando el comportamiento de los bots de búsqueda. | – Auditoría técnica de URLs. – Detección de etiquetas noindex, canonicals y redirecciones. – Identificación de errores 404 y duplicados. | – Rápido y completo. – Exporta datos en CSV y Excel. – Permite análisis offline. | Perfecto para auditorías SEO técnicas y revisión de grandes volúmenes de páginas. |

Ahrefs | Herramienta SEO avanzada que analiza backlinks, contenido e indexabilidad de sitios web. | – Explorador de sitios (Site Explorer). – Detección de páginas no indexadas o con errores. – Seguimiento de backlinks. | – Base de datos amplia y actualizada. – Métricas de autoridad y tráfico orgánico. | Recomendado para monitorear la indexabilidad y el perfil de enlaces en proyectos SEO profesionales. |

Semrush | Plataforma integral de marketing digital con herramientas SEO, SEM y análisis de contenido. | – Auditoría del sitio. – Detección de problemas de indexación y rastreo. – Sugerencias automáticas de optimización. | – Interfaz intuitiva. – Reportes visuales. – Integración con Google Analytics y Search Console. | Ideal para análisis continuos y reportes de rendimiento SEO para equipos de marketing. |

Sitebulb | Herramienta de auditoría SEO visual que combina análisis técnico y visualización de datos. | – Rastreo completo del sitio. – Mapas de arquitectura web. – Evaluación de indexabilidad y accesibilidad. | – Reportes visuales fáciles de interpretar. – Indicadores de prioridad en problemas detectados. | Excelente para identificar y comunicar problemas técnicos a equipos no especializados. |

IndexMeNow / Instant Indexing Tools | Herramientas diseñadas para acelerar la indexación de nuevas páginas o contenido actualizado. | – Envío manual o automático de URLs a motores de búsqueda. – Seguimiento del estado de indexación. | – Reduce el tiempo de indexación. – Compatible con múltiples motores (Google, Bing, Yandex). | Útil para sitios que publican contenido frecuente y necesitan indexación rápida. |

Te invitamos a seguir navegando por nuestro blog para que aprendas más sobre estos temas de SEO. Además, recuerda que siempre puedes ponerte en contacto con nuestra Agencia de posicionamiento si quieres que los expertos trabajen para ti.

Encuentra en Seology estrategias SEO para Hoteles, E Commerce, Universidades y cualquier otra industria.

Especialistas SEO en mercados latinoamericanos

Dominar conceptos como este es fundamental para una estrategia SEO exitosa. Si buscas implementar estas técnicas con el respaldo de expertos, en Seology te ayudamos. Nuestra agencia SEO Colombia ofrece soluciones personalizadas para el mercado colombiano, mientras que nuestra Agencia SEO en Chile está especializada en posicionar marcas en el competitivo mercado chileno.